随着越来越多的人工智能应用转移到智能手机上,深度学习模型越来越小,以允许应用运行得更快并节省电池电量。现在,麻省理工学院的研究人员有了一种新的更好的压缩模型的方法。

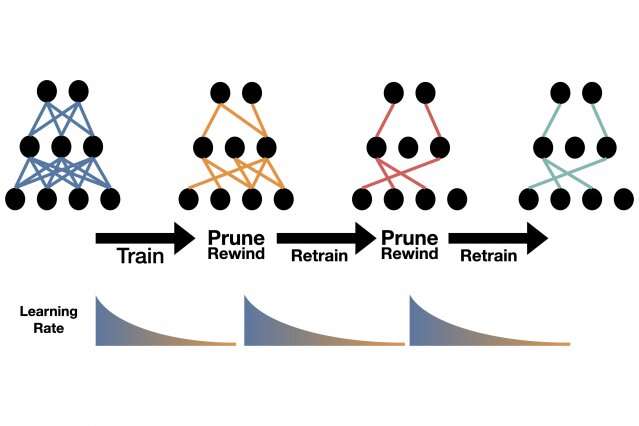

很简单,他们在上个月的一条推文中发布了它:训练模型,修剪它最弱的连接,以快速的早期训练速率重新训练它,然后重复它,直到模型达到您想要的大小。

“就是这样,”亚历克斯伦达博士说。麻省理工学院的学生。修剪模型的标准操作非常复杂。"

伦达在本月远程举行的国际学习大会(ICLR)上讨论了这项技术。Renda是麻省理工学院电气工程和计算机科学系(EECS)的学生,Michael Carbin是电气工程和计算机科学的助理教授——都是计算机科学和人工科学实验室的成员,他与博士生Jonathan Frankle共同撰写了这项工作。

去年,在ICLR,Frankle和Carbin赢得了大奖彩票假设论文,以寻求更好的压缩技术。他们表明,如果在训练的早期阶段找到了正确的子网,深度神经网络只能执行十分之一的连接。随着训练更大深度学习模型的计算能力和能量需求的指数级增长,这一启示一直延续至今。这种增长的成本包括全球变暖碳排放的增加,以及不属于大型科技公司的研究人员对稀缺计算资源的竞争导致的创新潜力的下降。每天的用户也会受到影响。大型AI机型会消耗手机的带宽和电池电量。

彩票假说引发了一系列后续论文,主要是理论上的。然而,在同事的建议下,Frankler决定看看它可能修剪哪些课程,其中搜索算法修剪了搜索树中评估的节点数量。这一领域已经存在了几十年,但在ImageNet竞赛中神经网络在图像分类上取得突破性成功后又重新出现。随着模型变得越来越大,研究人员添加了多层人工神经元来提高性能,而其他人则提出了减少它们的技术。

现在是麻省理工学院助理教授的宋涵就是一个先驱。在一系列有影响的论文的基础上,韩提出了一种剪枝算法,他称之为AMC或AutoML,用于模型压缩,这仍然是行业标准。在韩的技术下,冗余的神经元和连接被自动删除,模型被重新训练以恢复其初始精度。

作为对韩工作的回应,Frankle最近在一篇未发表的论文中建议,通过将较小的修剪模型反转到其初始参数或权重,并以更快的初始速率重新训练较小的模型,可以进一步改善结果。

在目前的ICLR研究中,研究人员意识到该模型可以简单地回归到其早期训练速度,而无需修改任何参数。在任何修剪方案中,模型越小,精度越低。然而,当研究人员将这种新方法与韩的AMC或Frankle的重绕方法进行比较时,无论模型有多小,其效果都更好。

目前还不清楚为什么修剪技术能如此有效。研究人员表示,他们将把这个问题留给其他人来回答。研究人员表示,对于那些想尝试的人来说,这种算法和其他修剪方法一样容易实现,而且不需要时间来调整。

“这是‘Book’中的剪枝算法,”Frankle说。“很明显,很普遍,也很简单。”

对韩来说,从一开始,重点就从压缩AI模型转向引导AI设计小而高效的模型。他的最新方法“为每个人做”也在ICLR首次亮相。关于新的学习率方法,他说:“我很高兴看到新的修剪和再培训技术不断发展,使更多的人能够使用高性能的AI应用。”